Fundamentos de Pesquisa em Ciência da Computação II

Seminários: leitura crítica de artigos científicos

Por: Alan Soares e Joenio Marques da Costa

Prof.: Cassio Vinicius Serafim Prazeres

Convite

Treinamento teórico & prático sobre Análise Qualitativa com a ferramenta Cortext Manager no IC-UFBA dias 27, 28 e 29 de Abril 2026

Inscrição:

https://grist.numerique.gouv.fr/o/docs/forms/prdoSSDvnoceRrdCiqk9nA/4

A escolha do artigo:

| Título | Swin Transformer: Hierarchical Vision Transformer using Shifted Windows [1] |

| Ano de publicação | 2021 |

| CAPES Qualis | A1 |

| Publicado em | International Conference on Computer Vision (ICCV) |

| Autores | Yutong Lin, Yue Cao, Han Hu, Yixuan Wei, Zheng Zhang, Stephen Lin, Baining Guo |

| Instituição | Microsoft Research Asia |

| Alguns números | 25582 citações; 17 citações em patentes; 30 referências |

[1] Z. Liu et al., “Swin Transformer: Hierarchical Vision Transformer using Shifted Windows”, em 2021 IEEE/CVF International Conference on Computer Vision (ICCV), out. 2021, p. 9992–10002. doi: 10.1109/ICCV48922.2021.00986.

Introdução e abstract

Apresentam a arquitetura Swin Transformer para visão computacional.

Desafio: problema de escala no tamanho de imagens e o impacto na alta complexidade computacional da autoatenção.

Tem sido ha muito tempo dominada por convolutional neural networks (CNNs)

Arquiteturas CNN evoluiram para se tornar poderosas em grande escala

Os avancos destas arquiteturas levaram a melhorias de performance que fizeram avancar todo o campo.

Introdução e abstract

O sucesso de Transformer no domínio da linguagem levou ao interesse de adaptar para o campo da visão computacional.

O tremendo sucesso do Transformer no dominio de linguagem levou pesquisadores a investigar sua adaptacao em computacao visual, onde foi recentemente demonstrado resultados promissores para certas tarefas, especificamente classificacao de imagens, e modelagem conjunta de visao e linguagem.

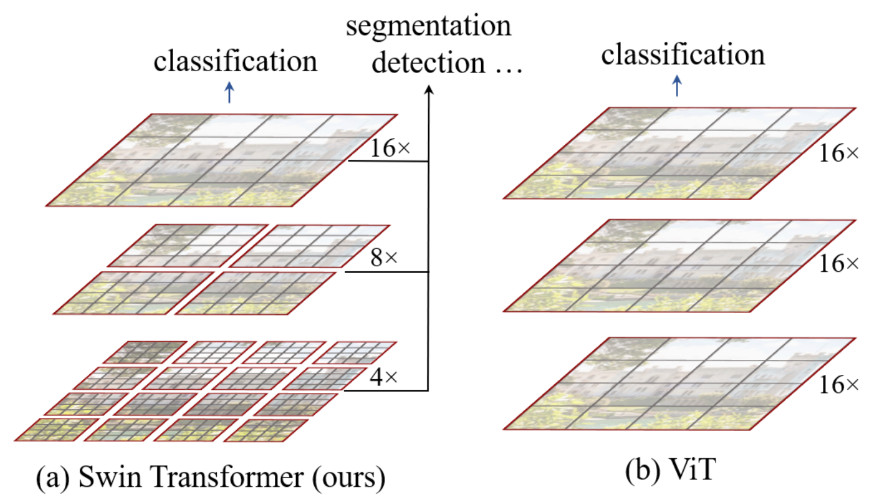

No artigo autores buscam expandir a aplicabilidade do Transformer de modo que possa servir como um backbone de proposito geral para visao computacional, assim como fez para NLP e como CNN faz em visão.

Existem muitas tarefas de visao como segmentacao semantica que requer predicao densa em nivel de pixel, e isto seria intratavel para Transformer em imagens de alta resolucao, ja que a complexidade computacional da autoatencao (self-attention) é quadrática para o tamanho da imagem.

Para superar estas questoes, propomos um Transformer backbone de proposito geral, chamado Swin Transformer, que constroi mapas de features hierarquicas e tem complexidade linear em relacao ao tamanho da imagem.

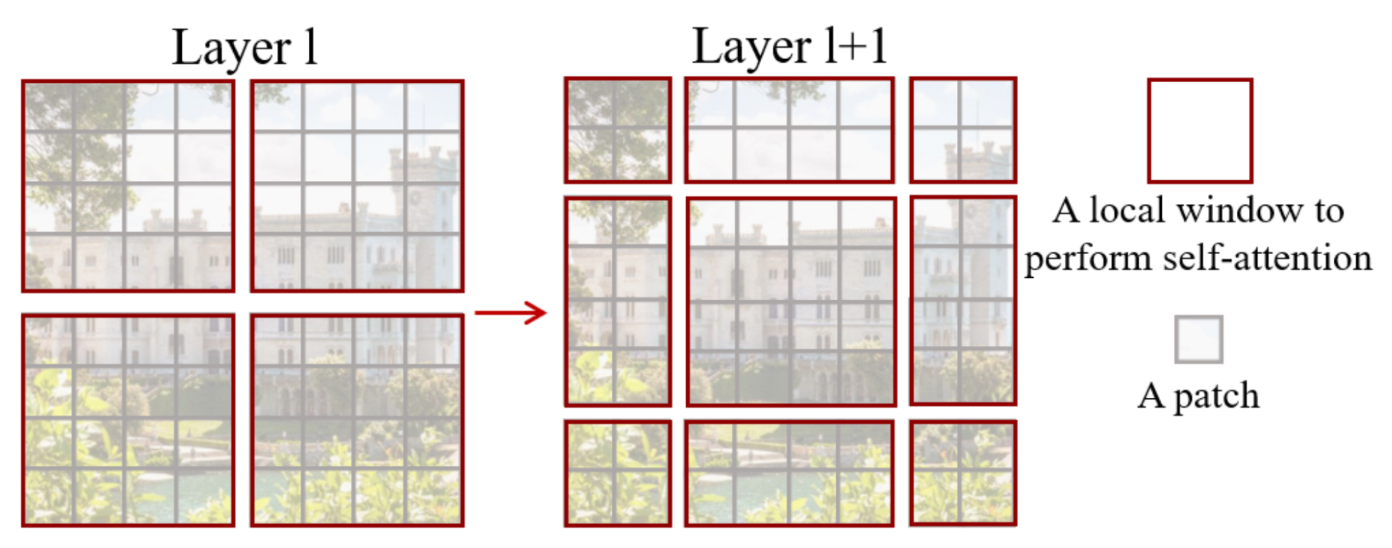

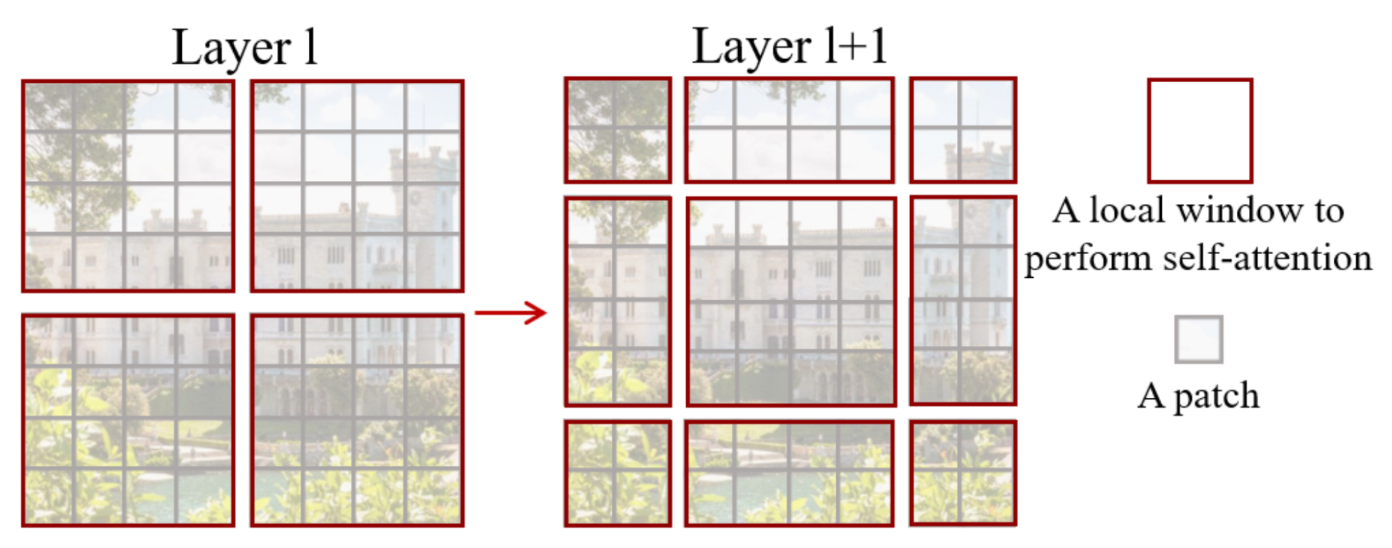

A complexidade computacional linear é atingida atraves do calculo da autoatencao (self-attention) localmente dentro de janelas nao sobrepostas que partilham uma imagem (descritas em vermelho).

O número de patches (fragmentos, camadas, trechos…) em cada janela é fixado, e entretanto a complexidade se torna linear em relacao ao tamanho da imagem.

Um elemento chave na arquitetura do Swin Transformer é sua shift de partições de janelas entre camadas de autoatencao consecutivas, como ilustrado na Figura 2.

Introdução e abstract

Solução: Um esquema de computação usando janelas deslocadas, melhor eficiência da computação de autoatenção. Bons resultados em:

- Classificação

- Predição

- Detecção de objetos

- Segmentação semântica

O código e os modelos estão publicamente disponíveis em:

👍 Abstract

- Tema bem definido: Swin Transformer

- Proposta de arquitetura para redes neurais artificiais

- Modelo de propósito geral para visão computacional

- Disponibilizam código-fonte no Github

👎 Abstract

- Risco de decaimento da URL Github

- Seria esperado arquivamento no Software Heritage ou Zenodo, incluindo identificador persistente

Swin Transformer = Shifted windows

👍 Introdução

- Swin Transformer atingiu bons resultados com complexidade linear

- Descreve arquiteturas de redes neurais convolucionais (CNN)

- Contraponto com arquiteturas de processamento de linguagem natural (NLP)

👎 Introdução

- Falta detalhes de implementação, quais linguagens, frameworks ou bibliotecas foram utilizadas

- O código-fonte é um artefato e uma contribuição científica e poderia ter algum espaço no texto

👍 Trabalhos relacionados

- Apresenta uma boa compreensão do campo, modelos e arquiteturas, como VGG e GoogleNet

- Traz o ViT como um dos modelos similares ao modelo implementado

- O ViT foi pioneiro no uso de fragmentos de imagens não sobrepostas para

classificação de imagens

- Isto proporcionou melhorias de velocidade em comparação com redes convolucionais

Método

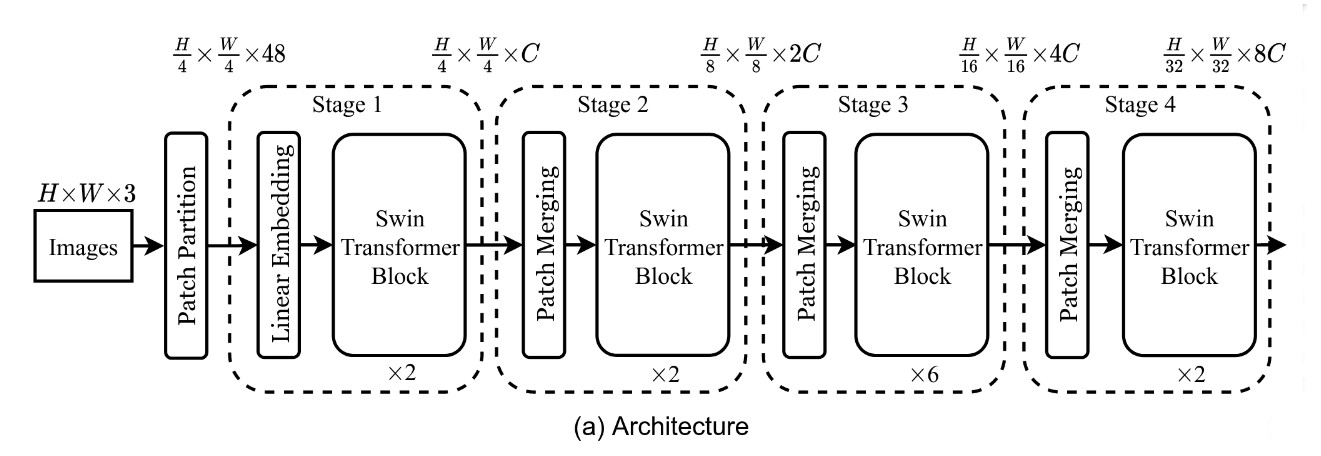

Arquitetura da variante pequena Swin-T.

Stage 1: Divide imagem RGB -> Concatena pixels RGB -> Embedding

Estágios combinados produzem representação hierárquica, com a mesmas resolucoes do mapa de features das típicas de redes convolucionais CGG e ResNet.

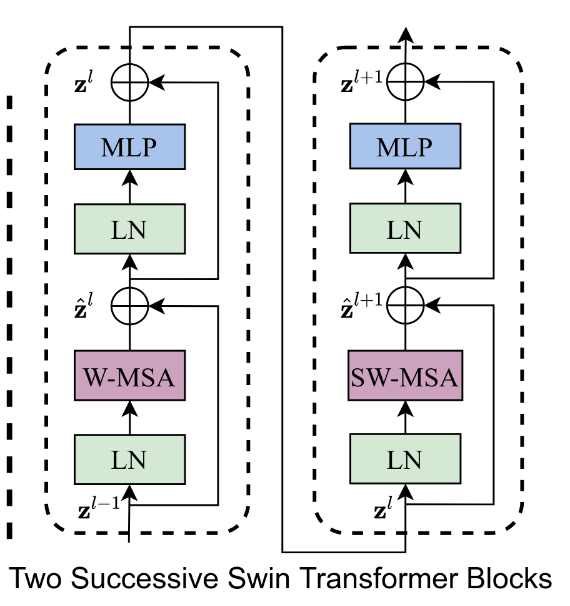

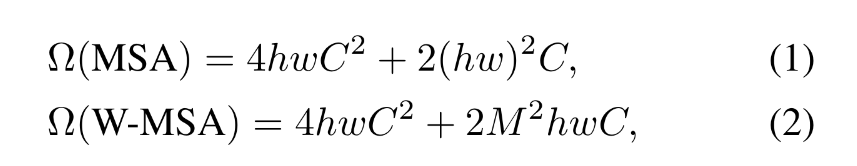

O Swin Transformer é construído substituindo o módulo padrão de multi-head self attention (MSA) (Traducao Wikipedia: autoatenção multicabeça) em um bloco de Transformer por um módulo baseado em janelas deslocadas (shifted windows), com as outras camadas mantidas sem alteração, como ilustrado na Figura 3(b).

A arquitetura padrão de Transformer possui complexidade quadratica em relacao ao numero de tokens.

O Swin Transformer computa autoatenção dentro de janelas locais, com complexidade linear em relacao ao tamanho da janela.

- (M, M): window size

- (h, w): feature map size

👍 Método

- Compara-se a implementação Swin Transformer com o modelo ViT

- Boas descrição dos estágios de transformação dos dados

- Formalização matemática e comparação de modelos

- Mostram a diferença entre o crescimento quadrático de alguns modelos, com o crescimento linear do modelo Swin Transformer

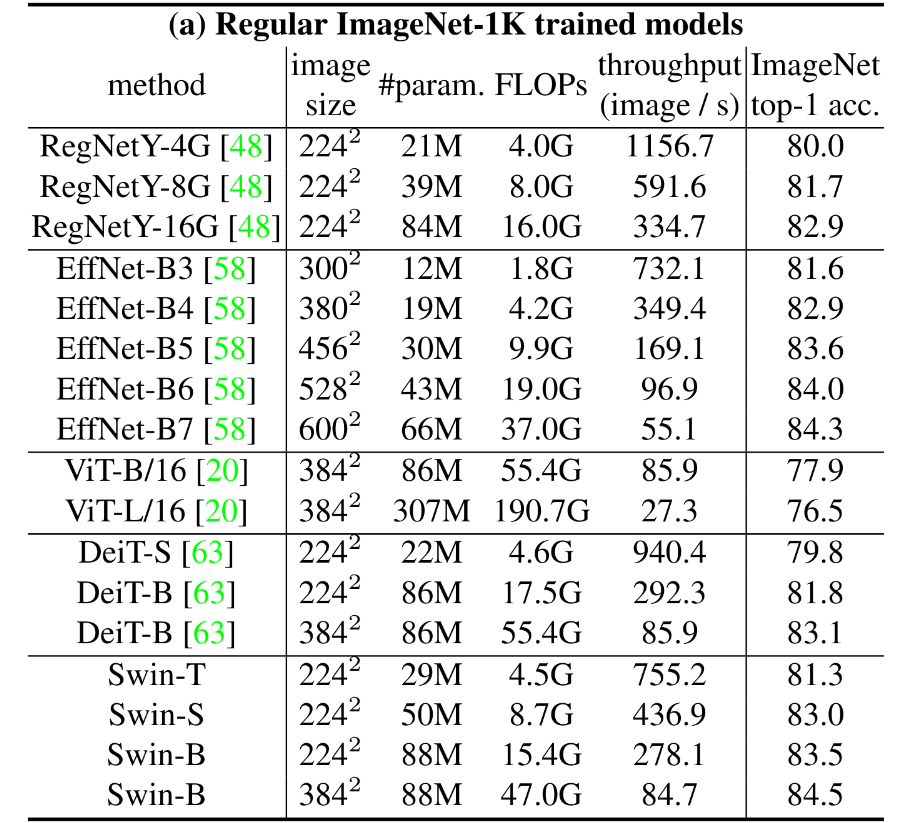

👍 Método

- Constroem variações Swin-B, Swin-T, Swin-L, Swin-S

- Comparam com outros modelos, como ViT-B/DeiT-B

- Apresentam dados em tabela, incluindo tamanho, complexidade computacional e vazão

👍 Experimentos

- Conduzem experimentos com os datasets ImageNet-1K, ImageNet-22K, ADE20K e COCO object detection

- Comparam o Swin Transformer com o estado da arte, eficiência em termos de tradeoff acurácia-velocidade

- Fazem benchmarks para classificação de imagens, detecção de objetos, e segmentação semântica

- Descrevem detalhadamente os experimentos em apêndice com informações adicionais

👍👍👍

- Apresenta adequadamente os conceitos teóricos

- Compara o modelo Swin Transformer com outros modelos

- Benchmarks ⇒ Reportam resultados

- Código-fonte disponível no Github

👎👎👎

- Faltam detalhes sobre linguagens ou bibliotecas usadas na implementação

- Identificador e arquivo permanente como alternativa adicional a URL do Github

Obrigado!

joenio@joenio.me

Esta apresentação está disponível em:

http://joenio.me/pgcomp-fundamentos-seminario-artigo

(código-fonte: https://gitlab.com/joenio/joenio.gitlab.io)

Histórico de apresentações

Onde e quando esta apresentação foi realizada

- 19 de Março de 2026, Salvador-Bahia, IC-UFBA